- Geplaatst op

- • Digitalisering

Overheid en digitalisering (6): publieke waarden afwegen

- Auteur

-

-

- Gebruiker

- Ron Roozendaal

- Bericht van deze auteur

- Bericht van deze auteur

-

Na 35 jaar werken aan digitalisering in de publieke sector geniet ik tijdelijk van een sabbatical. Het grootste deel van mijn loopbaan (tot nu) werkte ik binnen de overheid aan digitalisering. Een volgens sommigen slechte combinatie. Van verschillende kanten komt daarom ook de roep om een Minister voor digitalisering. Met reden, wat mij betreft. Maar er zijn veel meer verbetermogelijkheden. Dit is de zesde blog in een reeks die daarover gaat. Eerder in deze reeks beloofde ik al terug te komen op publieke waarden. Ik schreef toen over de relatie tussen transparantie en vertrouwen. En over het belang van transparantie over de waarden die je nastreeft en hoe je dat in de praktijk laat zien. Over die waarden en hun afweging gaat deze zesde blog. Met daarin elementen uit oudere blogs, want het is een onderwerp waarover ik al veel vaker schreef.

Digitalisering raakt publieke waarden

In de vierde blog in deze reeks schreef ik over de afhankelijkheid van externe producten en diensten. Die afhankelijkheid heeft de overheid, maar ook het bedrijfsleven en de samenleving. Ik schreef dat je over de keerzijde van die afhankelijkheid de krant maar hoeft open te slaan:

"Amerikaanse overheid kan bij e-mail van Nederlandse overheden en kritieke bedrijven" kopte de NOS recent nog. "Nederlandse overheid dreigt van Facebook af te gaan vanwege privacyrisico’s voor burgers" en scholen moeten goede afspraken maken over de privacy van gegevens van kinderen bij gebruik van digitale leermiddelen.

Publieke waarden vergen in elk individueel geval een afweging

De ethische afweging van publieke waarden kan in elk geval en per persoon anders zijn. Zo schreef ik eerder dat ik persoonlijk buikpijn had over client-side scanning. Ook betoogde ik eerder dat we anonimiteit op sociale media moeten koesteren. Dat ik daarover schreef is een teken dat digitalisering niet (alleen) een technische aangelegenheid is. Het gaat er bij digitalisering niet alleen om, bijvoorbeeld, of kwantumcomputing bestaande beveiligingsmethoden onveilig zal maken, dat ICT ons helpt om makkelijker vakanties te boeken of studiefinanciering aan te vragen. Wat de afgelopen jaren duidelijk heeft gemaakt is dat digitalisering ook grote invloed heeft op onze samenleving. Helaas niet alleen ten goede.

Dat het mogelijk is om digitaal te bepalen of een uitkeringsgerechtigde in het buitenland verblijft, zoals het UWV deed, maakt het nog geen goed idee om dat te doen. Dat het mogelijk is om modellen te maken die fraudekans voorspellen, zoals de gemeente Rotterdam deed, maakt het nog geen goed idee om dat zo te doen dat je sommige groepen veel eerder verdenkt dan andere. Alle hulde overigens aan de Gemeente Rotterdam, die toen dat duidelijk werd ook de broncode van de gebruikte algoritmes ter beschikking stelde om er onderzoek naar te doen!

Digitalisering, kortom, heeft invloed op mensenrechten, op publieke waarden. Hoe je omgaat met de mogelijkheden die digitalisering biedt vraagt ook om een ethisch debat. Niet alles dat kan, is ook een goed idee. En, ook belangrijk, elke voorkomende situatie kun je van allerlei kanten bekijken. Er is niet een eenduidig waardenkader, waarin op volgorde van belangrijkheid de af te wegen waarden zijn opgenomen. Privacy, bijvoorbeeld, gaat niet altijd boven veiligheid. En veiligheid niet altijd boven privacy.

Een voorbeeld: de afweging van privacy en veiligheid

Een waardenafweging wordt mede bepaald door (en bepalend is voor) in welke maatschappij je wilt leven. In mijn vorige blog beschreef ik een gedachtenexperiment:

Huiselijk geweld vindt meestal achter de voordeur plaats. Kindermishandeling is daarom moeilijk tijdig te detecteren. Veel mensen hebben slimme speakers in huis. Om hun lampen te bedienen, om muziek te luisteren of ingebouwd in hun televisie, bijvoorbeeld. Wat zou het handig zijn als we de bedrijven achter die speakers, zoals Apple, Amazon en Google, zouden verplichten om met de ingebouwde microfoons te luisteren naar signalen van kindermishandeling en die door te geven aan opsporingsdiensten.

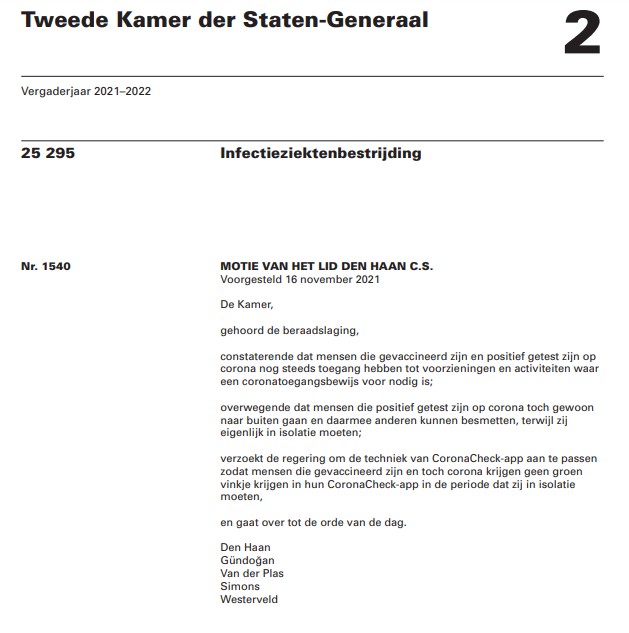

Niet alles dat kan is, alles afwegend, ook wenselijk. Een goed voorbeeld is het ontwerp van het Nederlandse Coronatoegangsbewijs (dat gelukkig al lang niet meer bestaat). Eerder beschreef ik dat het bewust niet mogelijk was om QR-codes te blokkeren als iemand positief had getest. Ook al had de Tweede Kamer, onder meer gesteund door Volt Nederland, Fractie Den Haan, PvdA, ChristenUnie, VVD en Pieter Omtzigt een motie aangenomen waarin stond dat de QR-code van positief geteste mensen moest worden geblokkeerd. Het ontwerp op basis van "privacy by design" voorkwam een – in mijn eigen persoonlijke afweging – onwenselijke situatie. Dat is het voordeel van "privacy by design": als je zo min mogelijk gegevens verwerkt kun je ze ook niet voor andere doelen gebruiken. Dat is ook een reden waarom ik wel meewerkte, zoals ik eerder schreef.

Het coronatoegangsbewijs was bewust zo ontworpen dat blokkeren niet mogelijk was. Er ligt een afweging tussen privacy en fraudebestrijding aan ten grondslag, die uitvalt in het voordeel van de privacy. Om na een positieve test te kunnen blokkeren bij het scannen zou er namelijk een publiek toegankelijke zwarte lijst van (codes van) positief geteste mensen moeten komen. Een lijst die voor iedereen beschikbaar is. Door het bestaan van zo'n zwarte lijst kan moedwillig de data van positieve testen verzameld worden en altijd bekend blijven dat iemand positief getest is geweest. Een dergelijke lijst kan ook gelekt worden. Dat dit niet hypothetisch was bleek uit een gelekte lijst waar de Belgische Gegevensbeschermingsautoriteit onderzoek naar deed.

Uit de aangenomen motie over blokkeren van QR-codes blijkt al dat de afweging van publieke waarden niet voor iedereen hetzelfde is. De verleiding om bij incidenten en op basis van krantenartikelen daadkrachtige stappen te willen zetten is groot (zie ook de eerste blog in deze reeks over hijgerige daadkracht). De "law and order"-reflex is dan vaak goed zichtbaar, ook als er negatieve gevolgen zijn voor andere publieke waarden.

Een voorbeeld: bestrijden van de verspreiding van kinderporno

Om de verspreiding van kinderporno te voorkomen is in de EU het voorstel gedaan voor “client side scanning”. In het kort: voor een plaatje via een app op een telefoon verstuurd wordt, zou moeten worden gecontroleerd of het verboden materiaal bevat. Van opgespoord verboden materiaal zou een "digitale vingerafdruk" moeten worden gemaakt op basis waarvan herkenning zou plaatsvinden.

Het gaat over CSAM, een voorstel van de Europese Commissie voor een Verordening ter voorkoming en bestrijding van seksueel misbruik van kinderen. Een voorstel, zou je zeggen, waar je niet tegen kunt zijn. En toch bevat het elementen waarvan ik buikpijn krijg. Daarvan pak ik er één uit:

Aanbieders van hostingdiensten en aanbieders van interpersoonlijke communicatiediensten die een opsporingsbevel hebben ontvangen, voeren dit uit door technologieën te installeren en te gebruiken om de verspreiding van bekend of nieuw materiaal van seksueel misbruik van kinderen of het benaderen van kinderen, naargelang het geval, op te sporen.

Wat hier van “interpersoonlijke communicatiediensten” zoals Whatsapp, Telegram, Signal en anderen gevraagd wordt, is dat ze dat ze berichten, voordat deze worden verstuurd, moeten scannen op bekend of nieuw materiaal. Voorstanders zeggen, overigens terecht, dat hiermee de versleutelde beveiliging van de communicatie niet wordt verbroken. Want het scannen van de berichten die mensen verzenden gebeurt immers voordat deze worden versleuteld. Het is alsof je zegt dat je het briefgeheim niet verbreekt, omdat je alleen maar over de schouder meeleest voordat de envelop wordt dichtgeplakt. Feitelijk correct, maar wil jij in een digitale samenleving leven waarin big tech over je schouder meeleest met elk bericht dat je schrijft?

Het voorstel leidde tot veel discussie. Of het wel mogelijk is om materiaal te herkennen bijvoorbeeld, en of communicatiediensten wel een belangrijke rol spelen bij de verspreiding van kinderporno. Voor mij is dat niet het belangrijkste, maar wel: hoe weeg je veiligheid en het voorkomen van schade af tegen privacy en autonomie. En ook: wat zijn de risico’s die eraan verbonden zijn. Risico’s die niet alleen maar fictief zijn, weet de Amerikaanse vader die op verzoek van een arts een close-up van het geslachtsdeel van zijn zoontje maakte die bij Google de alarmbellen liet afgaan.

Het voorstel vraagt niet alleen vertrouwen in bedrijven, maar ook in overheden. Die krijgen in het voorstel alle signalen door om op te volgen. Ook daar kunnen kwaadwillenden op in spelen. Om iemand in een kwaad daglicht te stellen is het de uitdaging om een onschuldig plaatje met dezelfde vingerafdruk te maken als een strafbaar plaatje. Zo'n zelfde vingerafdruk bij een ander plaatje is heel onwaarschijnlijk, maar niet onmogelijk. Net zoals het makkelijk is om door hele kleine wijzigingen aan een bekend plaatje te zorgen dat de vingerafdruk zo wijzigt dat deze niet meer herkend wordt. Jaap-Henk Hoepman schreef hier lezenswaardige blogs over.

De EDPB is kritisch, net zoals een grote groep wetenschappers en de Juridische Dienst van de Europese Commissie zelf. Die laatste vindt het een fundamentele schending van mensenrechten:

Other than the detection orders not being clear enough, the “screening of interpersonal communications” also affects “the fundamental right to respect for private life” because it gives access to interpersonal communications, such as text messages, emails, audio conversations, pictures, or any other kind of exchanged personal information.

It can also have a deterrent effect on the freedom of expression, the document says. Moreover, the data is also being processed, which “affects the right to protection of personal data.”

Op alle telefoons alle verzonden berichten scannen, dat is best een vergaand voorstel waar talrijke politici toch voor zijn. Een voorstel dat in de verte doet denken aan hoe in China mensen gevolgd worden. Niet alles dat digitaal kan is wenselijk, ook als dat tot gevolg heeft dat niet alle overtredingen, alle strafbare handelingen of alle fraude wordt opgespoord. Het gaat om het vinden van de juiste balans, om een ethisch debat.

Ethisch debat

Digitalisering heeft invloed op mensenrechten, op publieke waarden. Niet alles dat kan, is ook een goed idee. Maar er is niet een eenduidig waardenkader, waarin op volgorde van belangrijkheid de af te wegen waarden zijn opgenomen.

Welk waardenkader je gebruikt om waardenspanningen te beschouwen, en hoe je waarden in voorkomende gevallen weegt, kan in elke situatie anders zijn. Ook de uitkomst van de afweging kan voor iedereen, alles afwegend, anders zijn. Het is het gesprek dat telt. Daarom is het zo goed dat veel organisaties (zoals provincies en gemeenten) tegenwoordig ethische commissies instellen voor het beoordelen van digitalisering.

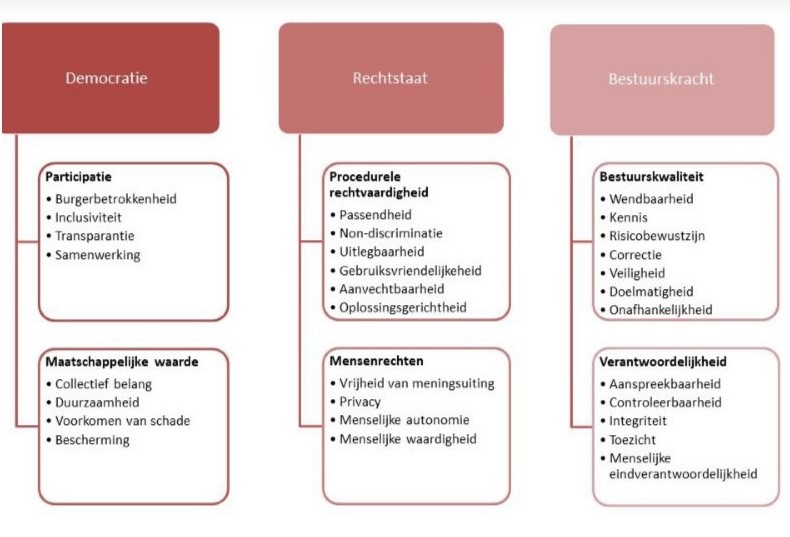

De bescherming van onze publieke waarden is uitgewerkt in wetgeving. De AVG ziet bijvoorbeeld toe op de bescherming van persoonsgegevens. Op basis van deze wet- en regelgeving zijn er diverse handreikingen opgesteld om organisaties te helpen deze waarden ook in de praktijk te beschermen. Voorbeeld hiervan zijn het Impact Assessment Mensenrechten Algoritmen (IAMA), de handreiking non-discriminatie by design en de Code Goed Digitaal Openbaar Bestuur (CODIO). Die laatste, de CODIO, heeft 3 kernwaarden: democratie, rechtsstaat en bestuurskracht. Daaronder liggen 30 waarden, zoals non-discriminatie, uitlegbaarheid en inclusiviteit.

Ik vind het een mooi overzichtelijk kader om te gebruiken als ik een situatie van meerdere kanten probeer te bekijken. Het bevat waarden als privacy, voorkomen van schade, bescherming en veiligheid. Waarden ook die een zorgvuldige en open afweging vergen bij voorstellen voor digitalisering. Want uiteindelijk gaat het erom in welke digitale samenleving je wilt leven.

En dus?

Eerder in deze blog gaf ik voorbeelden van provincies en gemeenten die ethische commissies in hebben gesteld. Ook kent het Ministerie van Financiën een Adviescommissie Analytics die adviseert over het ethisch verantwoord omgaan met data. Los daarvan worden individuele voorstellen ook al op initiatief van ministeries ethisch getoetst. Bijvoorbeeld met de aanpak Begeleidingsethiek. In die aanpak worden alle betrokkenen meegenomen, ook de mensen die worden geraakt door de voorstellen die worden beoordeeld. Er zijn dus goede voorbeelden, maar opschaling is nodig.

Mijn voorstel: kom tot een ethische commissie digitalisering voor het Rijk in navolging van de gemeenten, provincies en Rijksonderdelen die een dergelijke stap al hebben gezet.